최근 제미나이(Gemini)나 클로드(Claude) 같은 뛰어난 AI 모델들이 개발 환경에 깊숙이 들어오면서, 코딩 보조 도구는 이제 선택이 아닌 필수가 되어가고 있다. 하지만 매달 청구되는 유료 구독료가 부담스럽거나, 보안이 중요한 사내 코드가 외부 클라우드 서버로 전송된다는 찜찜함 때문에 사용을 망설이는 경우가 많았다.

오늘은 과금 걱정 없이, 완벽한 프라이버시를 유지하며 내 PC의 자원(8GB VRAM 기준)만으로 구동하는 '나만의 무료 코딩 어시스턴트'를 구축하는 방법을 기록해 보려 한다. 누구나 사용하는 무료 에디터인 VS Code에 'Continue' 확장 프로그램을 설치하여 로컬의 LM Studio와 직결하는 것이 핵심이다.

1. 왜 대세인 Cursor IDE 대신 VS Code인가?

최근 AI 코딩용으로 가장 각광받는 툴은 단연 'Cursor IDE'다. (참고로 Cursor 역시 VS Code를 기반으로 포크하여 만들어진 툴이다.) 하지만 클라우드 기반의 도구를 대체하기 위해, 이번 포스팅에서는 완전 무료인 VS Code와 오픈소스 확장 프로그램인 'Continue' 조합을 선택했다. 두 에디터의 구조적인 차이에서 오는 명확한 이유가 있었기 때문이다.

-

강제적인 백엔드 경유와 통신 시도: Cursor IDE의 설정창에 내 로컬 서버 주소(localhost)를 억지로 넣어도 정상 작동하지 않는다. 공식 문서와 개발자 포럼에 따르면, Cursor는 프롬프트를 조립하기 위해 반드시 사용자의 코드 데이터를 'Cursor의 클라우드 백엔드 서버'로 먼저 전송하도록 설계되어 있기 때문이다. 또한 사용자가 '프라이버시 모드'를 켜더라도, 에디터 자체는 위에서 언급한 사용 기록(Telemetry)을 서버로 보내기 위해 끊임없이 백그라운드 통신을 시도하는 성질을 띠고 있다.

-

100% 오프라인과 완벽한 보안: 반면 순정 VS Code에서는 Continue 확장 단 하나만 독립적으로 구동할 수 있다. 내 PC에 켜둔 LM Studio 서버와 외부망을 전혀 거치지 않고 '다이렉트'로 통신하므로, 랜선을 뽑고 비행기 안에서 코딩을 해도 작동하는 100% 오프라인, 100% 무료, 완벽한 프라이버시 환경이 완성되는 것이다.

2. 1단계: LM Studio를 로컬 서버로 변신시키기

먼저 내 PC에 켜져 있는 LM Studio가 VS Code의 질문을 받을 수 있도록 문을 열어주어야 했다.

-

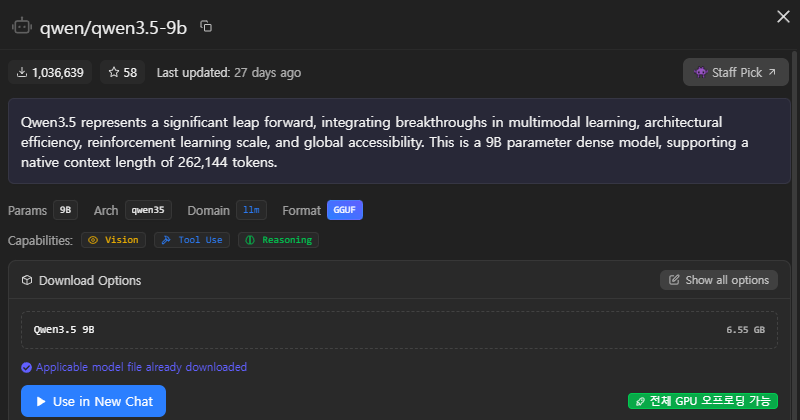

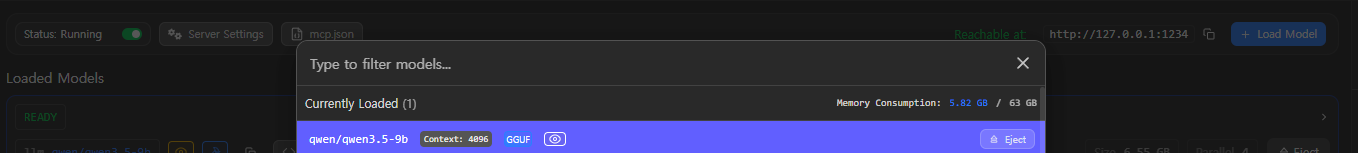

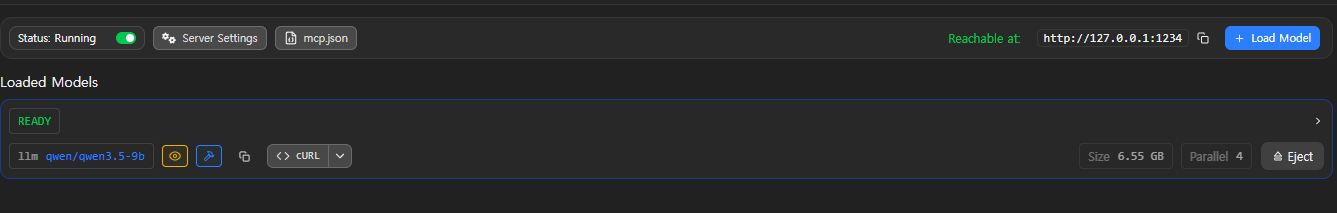

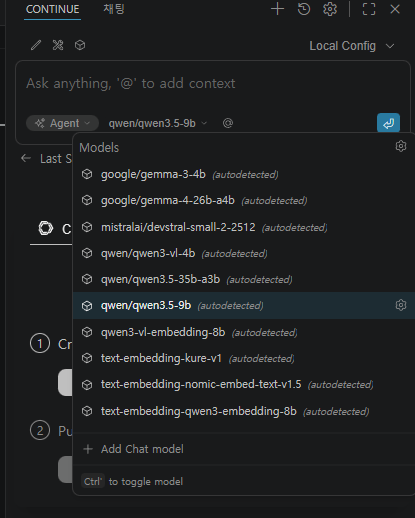

모델 로드: 8GB VRAM 환경에 맞춰 코딩에 특화된 7B~9B 체급의 모델(예:

qwen/qwen3.5-9b의 Q4 양자화 버전 등)을 불러온다.

필자는 Qwen의 qwen3.5-9B 모델을 기준으로 했다.

-

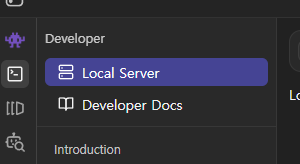

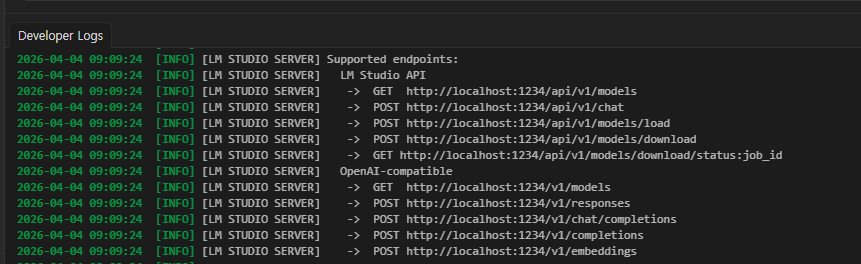

Local Server 탭 이동: LM Studio 좌측 메뉴에서 터미널 모양의 아이콘(Local Server)을 클릭한다.

-

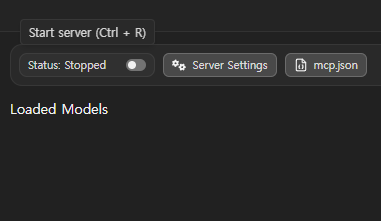

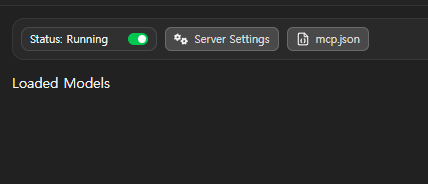

서버 가동: 상단의 status의 [토글 버튼을 클릭]하여 서버를 실행시킨다.

-

주소 확인: 하단 콘솔 창에

http://localhost:1234/v1이라는 주소가 뜨면 성공적으로 내 PC 안에 AI 서버가 구축된 것이다.

- 모델 불러오기 : Load Model을 클릭하여 이전에 설치했던

qwen/qwen3.5-9b모델을 실행한다.

- 최종 확인

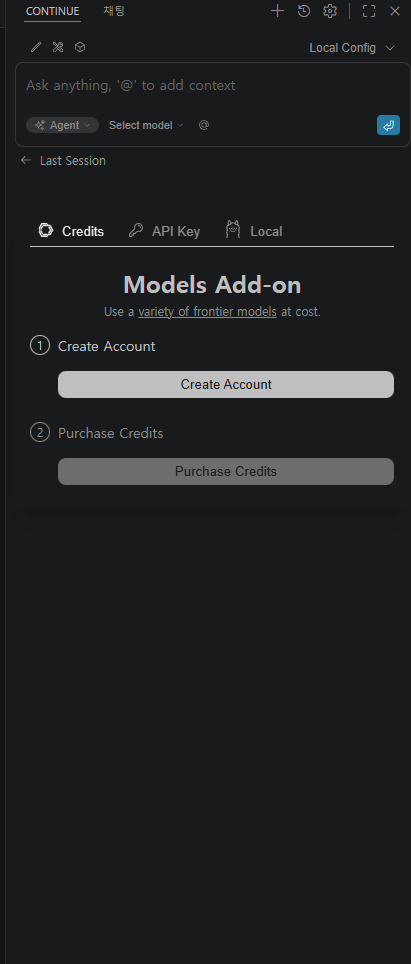

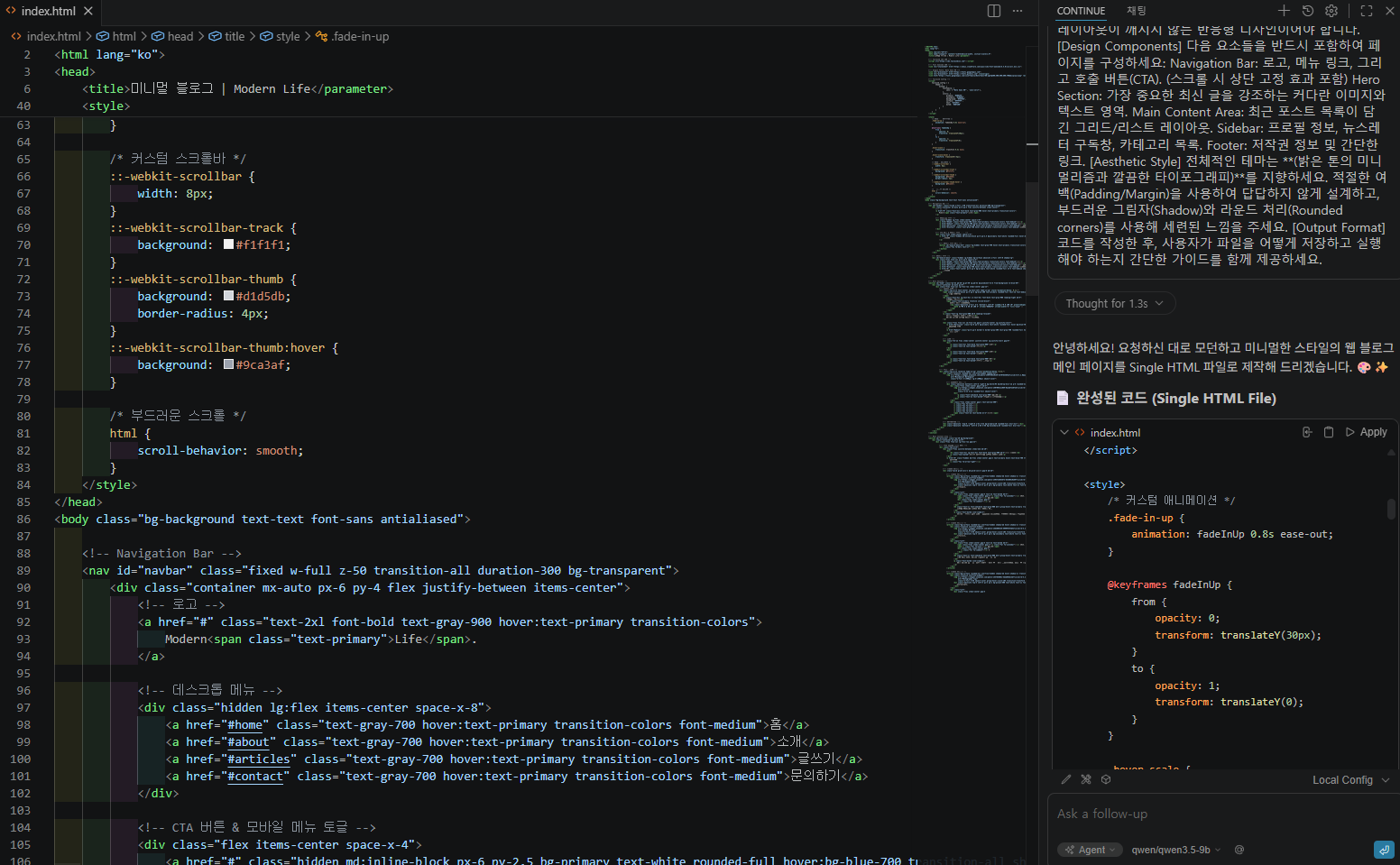

3. 2단계: VS Code에 Continue 설치 및 세팅

이제 VS Code 쪽에서 방금 만든 내 로컬 서버를 바라보도록 설정할 차례다.

-

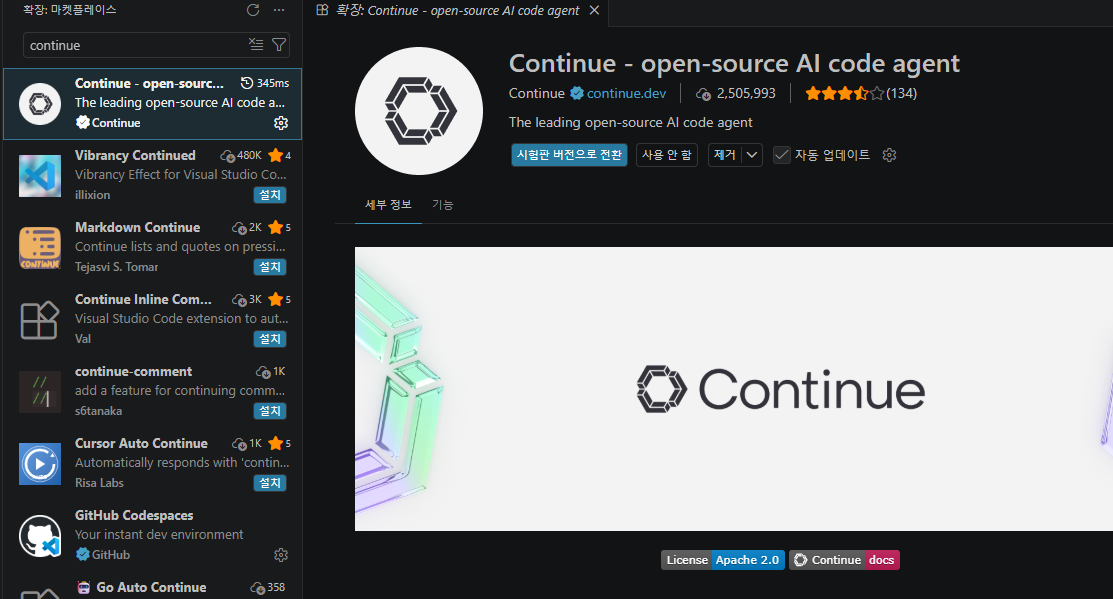

확장 프로그램 설치: VS Code 좌측의 'Extensions(확장, Ctrl+Shift+X)' 탭에서

Continue를 검색하여 설치한다.

- Continue 창 열기 :

Ctrl + L을 눌러서 continue창을 열어준다.

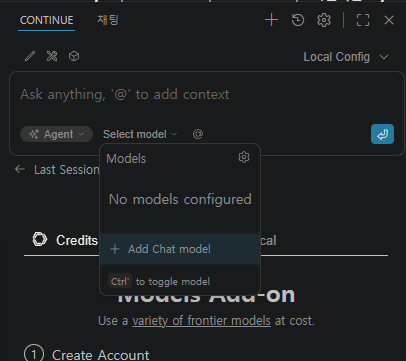

- LM Studio 툴 찾기 : 채팅창에 보이는 'select model'을 클릭하여 'Add chat model'을 클릭한다.

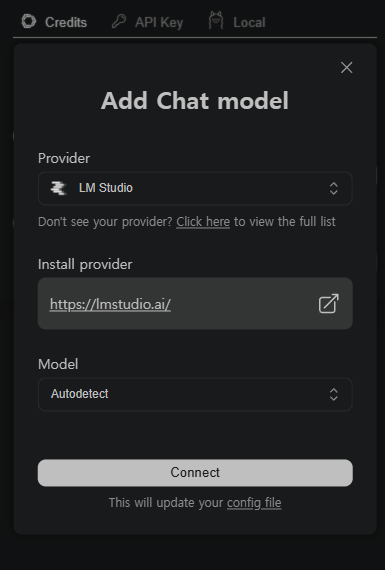

- LM Studio 툴 설정해주기 : provider를 클릭하여 LM Studio를 선택하고 Connect를 클릭한다.

- 모델 선택 : 오른쪽 채팅 화면을 보면 모델 선택란이 있다. 모델을 클릭하면 현재 LM Studio에 설치되어 있는 모델들을 선택할 수 있다. 이전에 설치했던 모델을 불러오도록 하자.

4. 💡 8GB VRAM 환경에서의 코딩 실전 팁

세팅을 마치고 Ctrl + L (또는 Cmd + L)을 눌러 Continue 채팅창을 열면, 내 로컬 AI와 바로 코딩 대화를 나눌 수 있었다. 실무에 적용해 보며 느낀 몇 가지 팁은 다음과 같다.

-

코딩 특화 모델 선택: 일반 대화형 모델보다 이름에

Coder나Code가 붙은 모델이 문법이나 코드 구조를 훨씬 정확하게 파악하고 짜주었다. -

컨텍스트(Context) 길이 타협: 8GB VRAM 사양에서는 소스 코드 전체를 통째로 AI에게 먹이면 메모리가 가득 차 속도가 심각하게 느려진다. LM Studio 설정에서 컨텍스트 길이를 4096~8192 정도로 맞추고, Continue 창에서 정말 필요한 파일이나 드래그한 특정 코드 블록만 넘겨주어 메모리를 절약하는 것이 가장 쾌적하다는 인상을 받았다.

맺으며

VS Code에 Continue 확장을 세팅하고 나니, 매월 나가는 구독료 걱정 없이 무제한으로 코딩을 도와주는 든든한 조력자가 생겼다. 무엇보다 코드가 외부로 유출될 걱정이 완벽히 사라져 마음 편히 코드를 물어볼 수 있게 되었다.

8GB VRAM이라는 대중적인 사양 안에서도, 적절한 코딩 특화 모델과 무료 IDE 연동 기술이 만나니 클라우드 유료 서비스 부럽지 않은 나만의 강력한 개발 환경이 완성되었다.

![[로컬 AI 실전] 코드가 밖으로 새지 않는 100% 무료 코딩 어시스턴트 구축하기 (VS Code + Continue)](https://evuelaimg.dothome.co.kr/blog/2026/04/img_69d067df1eec9_1775265759.png)

![[로컬 AI 가이드] 내 AI를 200% 똑똑하게 만드는 법: 프롬프트와 파라미터 최적화](https://evuelaimg.dothome.co.kr/blog/2026/03/img_69a941e13007e_1772700129.png)

![[로컬 AI 가이드] AI의 기억력을 결정하는 두 열쇠: 토큰(Token)과 컨텍스트(Context) 이해하기](https://evuelaimg.dothome.co.kr/blog/2026/03/img_69a7af6e027e3_1772597102.png)

![[로컬 AI 가이드] 내 PC의 한계를 끌어올리는 법: GPU 가속과 양자화(GGUF) 이해하기](https://evuelaimg.dothome.co.kr/blog/2026/03/img_69a544798eb98_1772438649.png)

댓글 0개